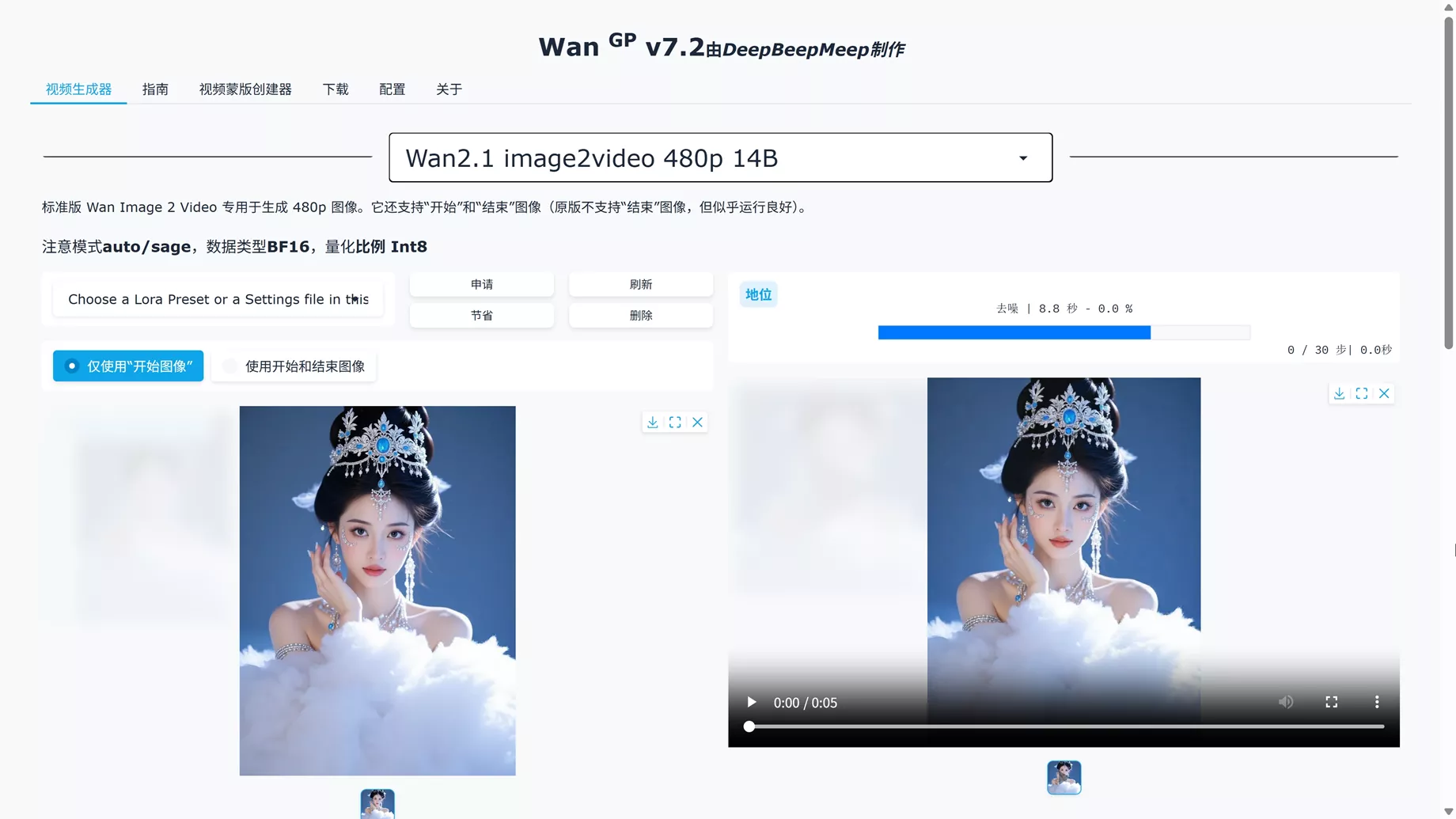

DeepBeepMeep 的 WanGP:GPU 匮乏也能访问的最佳开源视频生成模型

WanGP 支持 Wan(及衍生模型)、混元视频和 LTV 视频模型,其特点如下:

- 低 VRAM 要求(对于某些型号,低至 6 GB 的 VRAM 就足够了)

- 支持旧 GPU(RTX 10XX、20xx 等)

- 在最新的 GPU 上速度非常快

- 易于使用完全基于 Web 的界面

- 自动下载适合您特定架构的所需模型

- 集成工具以促进视频生成:蒙版编辑器、提示增强器、时间和空间生成、MMAudio、视频浏览器、姿势/深度/流量提取器

- Loras支持定制每个模型

- 内置大量的开源视频生成模型!

![图片[2]-Wan2GP AI视频生成神器安装教程! DeepBeepMeep 可视化UI界面,易操作!-零度博客](https://www.freedidi.com/wp-content/uploads/2025/07/6c1b77b22820250727125541.webp)

要求环境

RTX 10XX 至 RTX 40XX(稳定版)的安装

步骤1:下载并设置环境

git clone https://github.com/deepbeepmeep/Wan2GP.git

cd Wan2GP

conda create -n wan2gp python=3.10.9

conda activate wan2gp步骤2:安装PyTorch

pip install torch==2.6.0 torchvision torchaudio --index-url https://download.pytorch.org/whl/test/cu124步骤3:安装依赖项

pip install -r requirements.txt步骤 4:可选的性能优化(自由选择)

贤者注意力(速度提高 30%)

pip install triton-windowsSage 2 Attention(速度提高 40%)

pip install triton-windows

pip install https://github.com/woct0rdho/SageAttention/releases/download/v2.1.1-windows/sageattention-2.1.1+cu126torch2.6.0-cp310-cp310-win_amd64.whl运行使用方法:

python wgp.py # 文字转视频 (default)

python wgp.py --i2v # 图片转视频运行后在CMD下可以看到UI界面的地址:http://localhost:7860

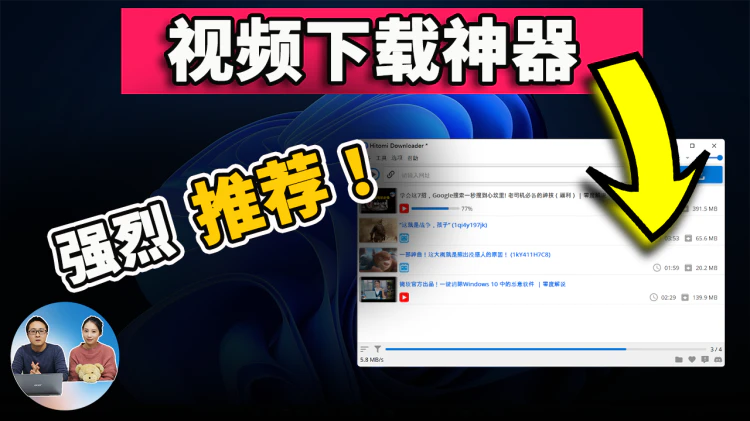

![图片[3]-Wan2GP AI视频生成神器安装教程! DeepBeepMeep 可视化UI界面,易操作!-零度博客](https://www.freedidi.com/wp-content/uploads/2025/07/b750eff1a020250727125101.webp)

里面有大量可选的开源视频模型可供你选择使用,都是完全免费的,支持多种分辨率

![图片[4]-Wan2GP AI视频生成神器安装教程! DeepBeepMeep 可视化UI界面,易操作!-零度博客](https://www.freedidi.com/wp-content/uploads/2025/07/00b43e1ba120250727125159.webp)

下次启动的话,只需执行下方的命令即可开启:

cd Wan2GP

python wgp.py --i2v![图片[5]-Wan2GP AI视频生成神器安装教程! DeepBeepMeep 可视化UI界面,易操作!-零度博客](https://www.freedidi.com/wp-content/uploads/2025/07/e3151bf0d120250727125234-scaled.webp)

如果你是50系列显卡,则使用这个部署命令:

git clone https://github.com/deepbeepmeep/Wan2GP.git

cd Wan2GP

conda create -n wan2gp python=3.10.9

conda activate wan2gp

pip install torch==2.7.0 torchvision torchaudio --index-url https://download.pytorch.org/whl/test/cu124

pip install -r requirements.txt部署成功后同样执行运行命令:

python wgp.py # Text-to-video (default)

python wgp.py --i2v # Image-to-video就可以愉快的使用了……….

THE END